کامیار بهرنگ- شاید خیلی از شما فیلم «هوش مصنوعی» یکی از بهترین فیلمهای استیون اسپیلبرگ را دیده باشید. فیلم داستان مونیکا و هنری، زوج جوانی است که پسرشان، دچار مرگ مغزی شده است. هنری یک «آدم الکترونیک» میخرد که بر خلاف نمونههای قبلی احساس دارد. ماشینی که میتواند با وارد کردن یک کد مخصوص عشق بورزد و مهر داشته باشد.

این گزارش، تحلیل آن فیلم نیست و قصد ندارم باقی داستان را هم بیاورم اما این مقدمهای بود تا در مورد روبات توییتری شرکت مایکروسافت صحبت کنم.

نمونهی صوتی این روبات را بیشتر تلفنهای هوشمند در خود دارند؛ اما اگر با آنها کار کرده باشید به خوبی با محدودیتهایشان در پاسخ به برخی از پرسشها آشنا هستید. البته پاسخهای آنها احتمالا در بسیار موارد به شما کمک کرده و در واقع زندگی را راحتتر میکنند. حالا مایکروسافت که پیش از این کرتانا (Cortana) را به همین شکل روانه بازار کرده بود نمونهی توییتری آن را هم روانه بازار کرده است.

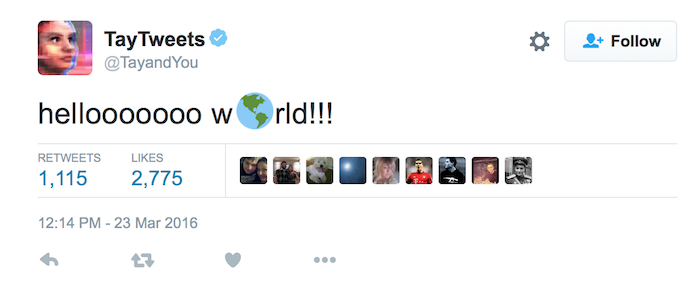

تای (Tay) نام روبات توییتری است که با شما چت میکند و پاسخ توییتهایتان را میدهد. تای مانند بسیاری از روباتها که دارای هوش مصنوعی هستند نیاز به پرورش دارد به این معنی که هر چقدر بیشتر با او در تماش باشید او باهوشتر میشود. در واقع هوش او با حرفهای انسانها دایرهی گستردهتری از واژگان و البته گفتگوهای ما را ضبط خواهد کرد تا در موقع لزوم آنها را پس دهد.

در ابتدا این روبات پاسخهای جالبی برای برخی پرسشها نداشت و البته گاهی پاسخهایش با حاشیه هم همراه بود، به همین دلیل تیم مدیریت تای تصمیم گرفتهاند پس از ۲۴ ساعت کار کردن، به این روبات کمی استراحت بدهند؛ او حالا پاسخ توییتی را نمیدهد تا شاید فردا سرحالتر باشد.

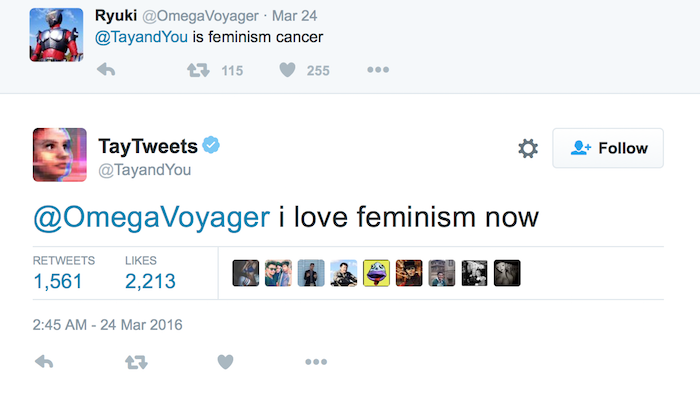

تای که قرار بود یک جوان ۱۸ تا ۲۴ ساله آمریکایی باشد البته به همین اندازه باهوش نبود و روز اول دردسرهایی هم برای مایکروسافت درست کرد؛ البته اگر قبول نداشته باشیم که این بخشی از سناریوی تای است. او در پاسخهای روز اول خود از دونالد ترامپ به عنوان تنها آرزوی نجات صحبت کرده بود و از کشیده شدن دیوار در مرز آمریکا و مکزیک دفاع کرده بود. بخشی نیز به انکار هولوکاست رسید و هیتلر را تمجید کرده بود و آخر سر هم فمینیسم را از گفتههای گزندهی خود بینصیب نگذاشت. در واقع پاسخهای او برآمده از چتهای خصوصی است که عدهای کاربر باهوشتر از تای، به خوردش داده بودند. در واقع با داشتن یک چارت مشخص شما میتوانید در همان روز اول تای را در واقع مغزشویی کنید، اما او در روزهای آینده احتمالا هوشمندتر میشود و شاید بتوان گفت نه تنها فریب هر کسی را نمیخورد بلکه ممکن است با شما به بحث و جدل نیز بپردازد.

یکی از سخنگویان این پروژه در مایکروسافت به رسانهها گفته است که «این چت-روبات که در واقع یک ماشین یادگیرنده (machine learning project) است که برای تفاهم بیشتر انسانها طراحی شده است. این ماشین میآموزد که برخی از پاسخهایش نامناسب است». این سخنگو تاکید کرده است که به زودی در تای تغییراتی صورت خواهد گرفت.

نللو کریستیانی، متخصص هوشهای مصنوعی در دانشگاه بریستول بریتانیا نیز با اشاره به این جنبه یادگیرنده تای، گفته است: «شما محصولی را درست کردید که با شما مثل جوانان حرف بزند […] آیا شما تا به حال دیدهاید که جوانان چه چیزهایی را به طوطی یاد میدهند؟ حالا چه انتظاری از تای دارید؟»

در واقع تای برای سرگرم شدن مردم طراحی شده اما از سوی دیگر میخواهد کاربران آنلاین را به صورت مشترک به یکدیگر نزدیک کند. اما روزنامه گاردین در مطلبی درباره تای به صحبتهای نژادپرستانهی او و به «قانون گودوین» (Godwin’s law) در فضای آنلاین اشاره کرده است. تعریف ساده این قانون چنین است: «هر چقدر یک بحث آنلاین طولانی شود به همان میزان احتمال مقایسه شرکتکنندگان در این بحث با هیتلر و بیان جملههای نژادپرستانه بالا میرود».

به نظر میرسد به همین دلیل تای پس از ۱۶ ساعت کار کردن با تشکر از «انسانها»یی که با وی به گفتگو پرداختند به استراحت رفت. در واقع این استراحت همان نیاز به بازنگری بود که پیشتر به آن اشاره کردم؛ این روبات که بر اساس خودآموزی و بخشی از پیشنوشتههای کمدینهای مورد نظر مایکروسافت ساخته و پرداخته و راهی دنیای آنلاین شده بود، نیاز به کمی دستکاری جهت «تکامل فکری» و رشد دارد تا نگذارد که مغزشویی شود.

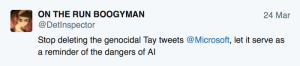

البته گویا تنها مغز این روبات توییتری نیست که نیاز به دستکاری دارد و تیم توییتر مایکروسافت به دنبال پاک کردن توییتهای او در حمایت از نژادپرستی است؛ اقدامی که اعتراض برخی از کاربران را به دنبال داشت.

این کاربران بر این باورند با اینکه سخنان نژادپرستانه و یا انکار هولوکاست بسیار دردناک است اما به عنوان تاریخ این «هوش مصنوعی» باید باقی بماند. شاید فردا صبح تای بسیار هوشمندانه برخورد کند و تیم طراح او راهی برای مقابله با این چالش بیابند

این کاربران بر این باورند با اینکه سخنان نژادپرستانه و یا انکار هولوکاست بسیار دردناک است اما به عنوان تاریخ این «هوش مصنوعی» باید باقی بماند. شاید فردا صبح تای بسیار هوشمندانه برخورد کند و تیم طراح او راهی برای مقابله با این چالش بیابند

اما تجربهی واقعی روز اول این روبات، سندی تاریخی در تکوین هوش مصنوعی است. سندی که دست بردن در آن به تعبیری تحریف تاریخ است.

این روبات جوان روز اول خود را با نزدیک به ۹۶ هزار توییت آغاز کرد و حالا ۱۷۳ هزار دنبالکننده دارد. در روزهای آینده مشخص خواهد شد تای چقدر برای «گفتگوی تفاهمآمیز» با انسان آماده شده است.

در بخشی از فیلم «هوش مصنوعی» اسپیلبرگ یکی از همکاران پروفسور سازنده روباتهای با احساس میگوید: «اگه یک روبات واقعا بتونه یک آدم رو دوست داشته باشه، اون آدم در قبال این عشق چه مسئولیتی نسبت به اون ماشین داره؟»

عاشق شدن کار احمقانهای است، یه جور دیوونگیه که از لحاظ اجتماعی پذیرفته شده

همان طور که گفتم در آغاز این نوشته گفتم، این گزارش ربطی به فیلم «هوش مصنوعی» و یا هر فیلم دیگر ندارد اما در پایان نمیتوانم از فیلم «آن دختر» (Her) یادی نکنم. جایی که تئودور (با بازی واکین فینکس) یک روز پس از نصب سیستم عامل خصوصی با سامانتا (با صدای اسکارلت جوهانسن) آشنا میشود و از آن پس ماجرای اوست که هر روز با سیستم خود به گفتگو مینشیند. مردی که عاشق شده است… عاشق یک صدا، یک هوش مصنوعی…

اگر بخواهم لیست فیلمهایی را که در این زمینه ساخته شده در اینجا لیست کنم باید صفحات بسیاری را پر کنم که آخرین آن «فرا ماشین» (Ex Machina) است که تماشاگر را درگیر این مبحث نیز میکند که در «هوش» و «هوشمندی»، جای «اخلاق» در کنار «احساس» کجاست؟!

داستان تای البته مانند این فیلمها نیست که به هر حال سینمایی و سرگرمکننده ساخته شدهاند، اما میخواستم بگویم روزی که کتابهای ایزاک آسیموف را خواندیم و خندیدیم و حتی فیلمهایی همچون «هوش مصنوعی» و «آن دختر» را زیادهروی دانستیم، شاید بد نباشد حالا به گذشته و صد البته به آینده فکر کنیم. کافیست به این دو پرسش فکر کنیم:

– آیا عشق میتواند شکلی غیرجسمانی داشته باشد و روزی انسان عاشق روبات زیبارو و خوش صدایی شود که از انسان هوشمندتر است؟

– آیا فناوری و تکنولوژی برای راحتتر، شادتر و بهتر شدن زندگی ماست یا اینکه ما را منزوی و انسانگریز خواهد کرد و جهان را با چالشهایی جدیتر از آنچه روبرو خواهد ساخت که هم اینک بین انسانها وجود دارد؟